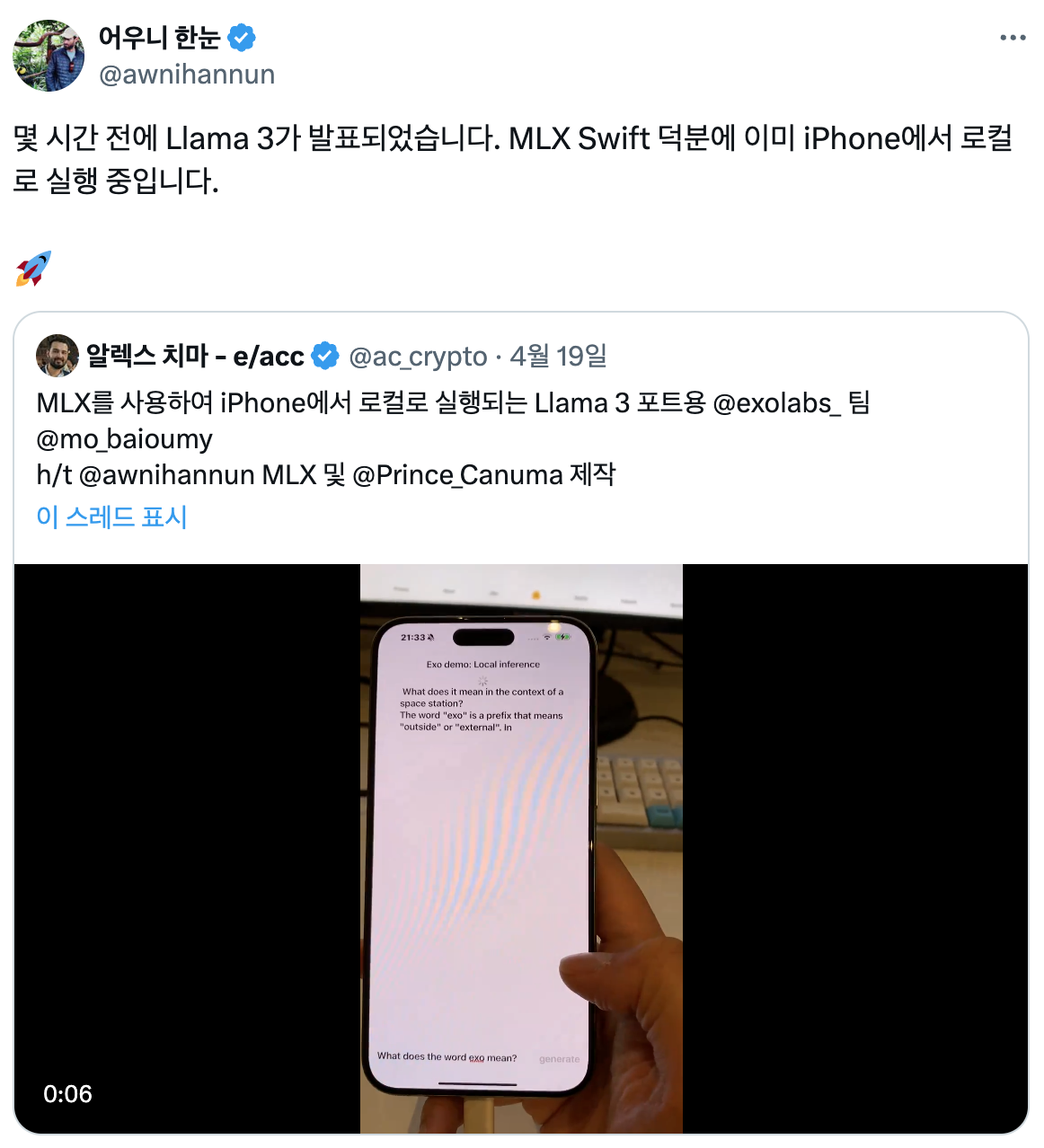

메타가 얼마전 발표한 언어모델 Llama 3 8B 4bit 모델을 @exolabs_ 팀이 MLX 프레임워크를 이용해 아이폰에서 로컬로 구동하는데 성공했습니다.

MLX는 애플의 AI 연구자인 아우니 하눈(Awni Hannun)주도하에 개발중인 애플 실리콘 칩에서의 AI 연산 가속 연구를 위한 행렬연산 프레임워크입니다.

메타에서 생성형 AI 를 이끌고 있는 Ahmad Al-Dahle는 매우 인상적이라는 평을 남겼습니다.

메타가 얼마전 발표한 언어모델 Llama 3 8B 4bit 모델을 @exolabs_ 팀이 MLX 프레임워크를 이용해 아이폰에서 로컬로 구동하는데 성공했습니다.

MLX는 애플의 AI 연구자인 아우니 하눈(Awni Hannun)주도하에 개발중인 애플 실리콘 칩에서의 AI 연산 가속 연구를 위한 행렬연산 프레임워크입니다.

메타에서 생성형 AI 를 이끌고 있는 Ahmad Al-Dahle는 매우 인상적이라는 평을 남겼습니다.

에 충분히 대응할 수 있지 않을까 예상해봅니다.

인텔에서 메테오레이크로 돌린 Llama 구동 시연도 NPU를 쓰지 않았더군요.

그만큼 NPU 활용하기가 까다롭고 구조도 저마다 다르기에 단순 TOPS 수치로 성능을 가늠하는건 어렵습니다. 마치 RPM 수치로 엔진 성능을 비교하는것과 비슷해요. 그래서 해당 NPU로 특정 온디바이스 AI가 구동될지 안될지는 나와봐야 알수 있을거에요.

애플이라면 A칩 NPU의 혈을 뚫어서 자체 모델을 돌리지 않을까요?